|

実世界の複雑な状況下において自律的に動作する計算機システムにとって,実世界における動的状況の理解は不可欠な機能である.このような動的状況の理解はコンピュータビジョンの分野において長年にわたり研究されており,これらの研究において得られた知見は,各種実世界システムに対して適用されている.

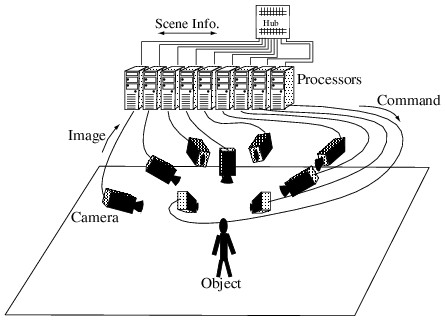

しかし,実世界で起こる多種多様な動的状況を視覚システムで認識・理解するためには「柔軟性」「頑健性」「実時間性」など様々な問題がある.そこで我々は,これらの問題を解決するためのフレームワークとして分散協調視覚システム(図1,リンク[1])に注目し,その機能実現・応用に関する研究を行っている.

分散協調視覚システムとは,それぞれアクティブカメラ(首振り,ズーミング,移動などのアクションを行うことにより能動的観測が可能なカメラ)を備えた分散計算機群が相互にネットワーク結合されているシステムである.分散協調視覚システムを利用することにより,以下のような利点が得られる.

|

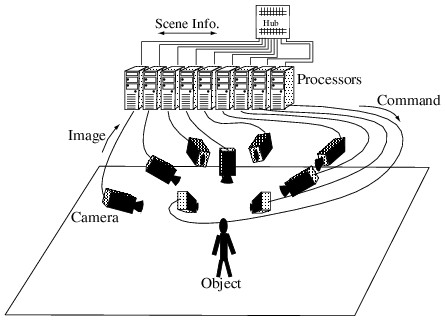

我々の研究グループでは,具体的に図2に示すような実験設備を利用して分散協調視覚システムの研究を進めている.他研究室で行われている同様の研究と比較した際の特徴的な点として,各カメラは広範囲を観測するための首振り機構(パン・チルト機構)と観測対象の詳細な情報を得るためのズーム機構を備えている.こうしたパン・チルト・ズームカメラを用いることにより対象を継続的に注視しながらズームアップした詳細な画像が得られるため,撮影画像から観測対象の形状復元,物体種類の識別,などを行う際に優れた結果を得ることが可能となる.

しかし,こうしたパン・チルト・ズームカメラのみに限らず,研究目的に応じて様々な種類のカメラ(例を図3に示す)も積極的に利用していく.

|

|

こうした分散協調視覚システムの利用により,

中でも我々は多数対象の広範囲追跡に興味を持って研究を進めている (我々の分散協調視覚システムによる対象追跡研究の紹介).